유럽선 데이터 기준 엄격..."평가기술 표준화" 목소리

[서울·대전=뉴스핌] 김수진 기자 = '인공지능(AI)은 학습한 데이터만큼만 똑똑하다'

AI 편향성을 없애기 위한 연구가 활발하다. AI 편향성 문제는 상용화를 가로막는 큰 장벽이기 때문이다. 과거 AI가 흑인을 고릴라로 착각하거나, 성차별적인 발언을 하는 등 사회적 문제를 일으키면서 오히려 관련 산업발전이 잠시 후퇴하는 부작용을 일으킨 뼈 아픈 과거가 있다. 실제로 우리나라에서는 성차별적 발언한 '이루다'를 개발한 스캐터랩이 1억300만원의 과징금·과태료를 부과받으며 사회적으로 큰 비난받기도 했다.

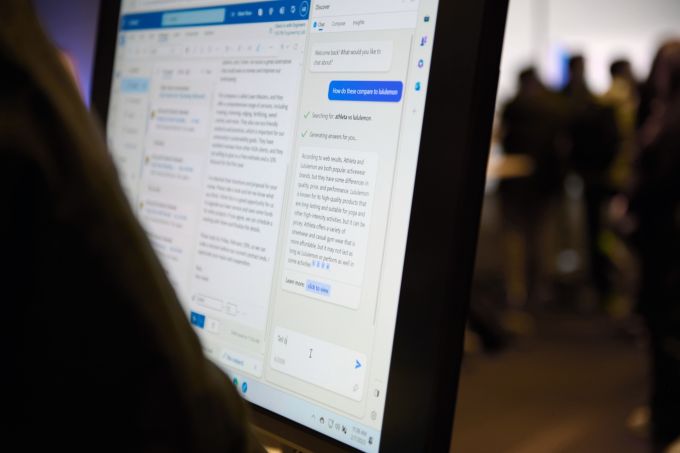

하지만 지난해 연말 등장한 챗GPT가 전 세계적으로 큰 반향을 일으키면서 AI에 대중의 시선이 쏠렸다. 때문에 또 다시 불어온 AI에 대한 시장의 관심을 놓치지 않기 위해 시장에서는 편향성 제거에 열을 올리고 있다.

윤리성 '더' 확보한 GPT-4

미국 현지시각 지난 14일 오픈AI가 챗GPT를 넘어서는 GPT-4를 출시하면 뜨거운 관심을 받고 있다. GPT-4는 챗GPT(GPT-3.5)와 비교해 인식 및 추론능력이 향상됐으며 이미지 입력 인식 능력, 대화 메모리 향상 등의 기능을 탑재했다. 기존 GPT-3.5와 비교해 요구한 질의에 대한 문제를 보다 창의적이고 정확하게 작성하며 작문 능력이 크게 향상됐다.

오픈AI는 특히 GPT-4가 기존보다 신뢰성을 확보했다고 주장했다. 사용자의 악의적인 질의에 대한 대응훈련을 통해 기존보다 윤리적인 측면의 답변을 할 수 있도록 진화했다는 것이다. 오픈AI 샘 알트먼 CEO는 "GPT-4가 기존 대비 82% 더 윤리적으로 안전하고 40% 더 정확하다"며 설명했다.

소프트웨어정책연구소도 얼마 전 발간한 AI 브리프 특집호에서 "현재 챗봇은 사용자의 악의적인 이용에 의해 쉽게 오염되는데 GPT-4는 기존 대비 면역력이 강화됐다"며 "기존 제품에 비해 윤리성을 확보했다"고 평가했다.

세계는 데이터 신뢰성 전쟁 중...한국은?

산업계에서는 GPT-4의 윤리성 확보가 이슈됨에 따라 데이터 시장 중요성이 더욱 커질 것으로 내다봤다. 미국 통신사 블룸버그는 현재 경기 전망리포트 콘텐츠 30%를 AI에 의존하고 있는데 26년에는 90%이상 늘어날 것으로 전망했다.

국내 한 AI기업 관련 연구원은 "그간 AI 데이터 중요성은 관련 업계 내에서나 이슈돼 왔는데 챗GPT가 전세계적으로 히트치면서 대중들까지도 질 좋은 데이터가 필요하다는 걸 알게 됐다"며 "지금이 데이터 관련 산업을 일으키기에 적기"라고 강조했다.

하지만 막상 국내 데이터 시장을 살펴보면 초라한 상황이다. 과학기술정보통신부가 발표한 현재 우리나라 데이터산업 시장 규모는 2021년 기준 20조 24억원 규모로, 미국의 7.0%, 유럽연합의 16.4%에 불과하다. 지난 문재인 정부 시절 데이터댐' 사업에 수 조원을 투입했지만 아쉬운 성적표다. 구축한 데이터도 대부분이 행정·공공데이터에 치우쳐 있고 제품 품질도 보장할 수 있는 수준이 아니라는 지적도 일고 있다.

AI를 현장에서 활용 중인 산업계에서 데이터 신뢰성 확보는 시급한 문제다. 충북 청주에서 드론 관련 벤처기업을 운영 중인 한영운(31) 대표는 "사실상 현재 정부가 축적한 데이터를 그대로 AI에 적용하기에는 아무래도 위험부담이 있다"며 "이제라도 AI 편향·오류를 최소화하는 표준 기술이나 제도 마련이 있어야 시장이 빠르게 성장할 것"이라고 말했다.

의료계에서도 AI 데이터 품질 확보가 필수라고 입을 모은다. 지난달 16일 열린 빅데이터임상활용연구회 세미나에서 윤덕용 연세대 의과대학 의생명시스템정보학교실 교수는 "의료 AI 모델 성패는 양질의 데이터에 달렸다"며 "의료 AI모델이 특정 편향된 데이터만 학습할 경우 의료 불평등까지 야기할 수 있다"고 지적하기도 했다. 그는 "양질의 데이터 축적이 중요하다"며 "국민을 대표하는 양질의 표준화된 데이터 확보가 중요하다"고 강조했다.

이미 선진국에서는 AI 데이터 품질 확보에 발빠르게 나선 상태다. 현재 유럽의회가 2025년 제정 목표로 인공지능법 도입을 검토 중인데, 데이터 편향·오류 방지를 의무화하는 내용을 세세하게 규정하고 있다. 관련 법을 어기거나 금지된 분야에 AI기술을 접목할 경우 최대 3000만 유로, 또는 세계 매출액의 6%에 달하는 벌금을 물도록하고 있다.

하지만 국내 도입 준비 중인 AI 관련 법안은 데이터 품질이나 편향 방지에 대해 '언급만' 한 상태로 봐도 무방하다는 지적이다.

"AI데이터 평가 기술 표준화 필요"

때문에 AI 편향을 막기 위해 AI학습 데이터 개발 및 활용에 정부가 적절히 나서야 한다는 주장이 힘을 얻고 있다. 시장이 폭발적으로 성장함에 따라 AI 기업과 개발자 '양심'에만 맡겨놓을 수 없다는 지적이다.

정부도 관련 산업 활성화를 위해 나서야 한다는데 공감하고 있다. 과기정통부는 AI 부작용 등 제도적 보완을 마련하는 내용으로 2024년부터 5년간 AI 연구에 3000억원을 투입한다는 계획이다. 엄열 과기정통부 인공지능기반정책관은 지난 7일 열린 2023 대한민국 AI토크 콘서트에서 "AI의 편향된 정보나 환각이 위험할 수 있다"며 "오류가 있는 언어 모델 한계를 뛰어넘는 AI 기술 발전을 위해 지원을 늘리겠다"고 말했다.

장진철 소프트웨어정책연구소 디지털통계센터 선임연구원도 "최근 AI는 모델 성능보다 데이터 역할을 강조하는 경향이 커졌다"며 "때문에 데이터관리 체계에 대한 지원이 중요하다"고 밝혔다. 장 선임연구원은 "AI에 활용되는 데이터 최적화와 관리 역량이 AI 시장 확산의 필수요건으로 대두되고 있다"며 "관련 인력 양성 방안이 정부-산업-교육계 협력을 통해 논의돼야 한다"고 강조했다.

산업계에서는 AI데이터 평가 기술 표준화가 필요하다는 목소리가 커지고 있다. AI 데이터를 평가할 기준을 바로 세워달라는 요구가 거세다. 소프트웨어 공학 전문기업 씽크포비엘 박지환 대표는 "객관적인 검증법 없이 단지 담당자의 경험이나 주관에 의존한 검사방법이 문제"라고 지적하며 "NIA가 자체 발간한 가이드가 있지만 '다양하게 수집한다'는 모호한 기준으로 현실적이지 못했다. 데이터의 질적 수준을 검증할 현실적이고 올바른 방법이 없는 상황"이라고 꼬집었다.

그러면서 박지환 대표는 "공공데이터 등 가치를 판단하고 개선점을 찾기 위한 AI 데이터 평가 기술 표준화가 필요하다"며 "지금같은 산업 전환기에 AI 데이터 신뢰성 기준을 빠르게 정립해 AI 시장에서 뒤처지지 않도록 정부와 산업, 학계 모두 힘을 합쳐야 할 시점"이라고 강조했다.

nn0416@newspim.com