정부 '독자 AI 모델' 사업 참여…기술 자립 가속

[서울=뉴스핌] 양태훈 기자 = 카카오가 자체 개발한 고성능 언어모델 2종을 연이어 오픈소스로 공개하며, 국내 생성형 AI 기술의 자립성과 효율성을 입증하고 있다.

24일 카카오는 허깅페이스를 통해 ▲경량 멀티모달 언어모델 'Kanana-1.5-v-3b'와 ▲MoE(Mixture of Experts) 언어모델 'Kanana-1.5-15.7b-a3b'를 오픈소스로 공개했다고 밝혔다.

이번 공개는 지난 5월 자체 언어모델 4종을 선보인 데 이어 약 두 달 만에 이뤄졌으며, 카카오는 독자적인 모델 설계 역량과 카카오톡 등 대규모 서비스 운영 경험을 바탕으로 정부의 '독자 AI 파운데이션 모델 프로젝트'에도 참여 중이다.

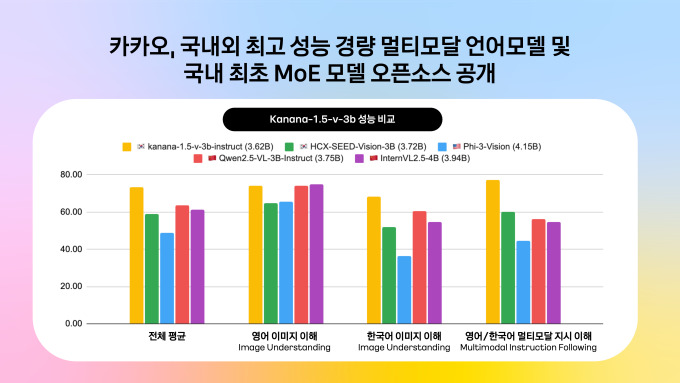

'Kanana-1.5-v-3b'는 이미지와 텍스트를 동시에 이해하고 자연어로 응답할 수 있는 경량 멀티모달 언어모델이다. 이 모델은 '프롬 스크래치(From Scratch)' 방식으로 자체 개발된 Kanana 1.5를 기반으로 확장됐으며, 지시 이행 성능과 이미지 이해 능력에서 글로벌 수준인 GPT-4o와 견줄 수 있는 성능을 확보했다.

특히 한국어 벤치마크에서는 동일 규모의 국내외 모델 대비 최고 점수를 기록했고, 영어 벤치마크에서도 유사한 수준의 성능을 보였다. 지시 이행 능력에서는 국내 공개 모델 대비 128% 수준의 성능을 나타냈다. 여기에 인간 선호 학습과 지식 증류 기술을 적용해 경량 모델임에도 대형 모델에 준하는 정확도와 언어 이해 성능을 확보했다.

이 모델은 이미지·텍스트 분석은 물론, 동화 창작, 문화유산 인식, 수학 문제 풀이 등 다양한 분야에 유연하게 활용될 수 있다. 예를 들어 사진을 입력하면 해당 장소나 사물을 인식해 정확한 설명을 제공하는 식이다.

같은 날 공개된 'Kanana-1.5-15.7b-a3b'는 국내 최초로 오픈소스로 공개된 MoE 구조 기반 언어모델이다. MoE는 모든 파라미터가 작동하는 밀집(Dense) 모델과 달리, 특정 작업에 최적화된 일부 전문가 모듈만 활성화돼 연산 효율성과 비용 절감에 강점을 갖는다. 글로벌 AI 업계에서도 각광받고 있는 최신 구조다.

카카오는 자사의 3B 규모 모델 'Kanana-Nano-1.5-3B'를 업사이클링 방식으로 확장해 MoE 모델을 구현했다. 전체 파라미터는 15.7B이지만, 추론 시 약 3B만 활성화돼 작동하며, 성능은 'Kanana-1.5-8B'와 동등하거나 더 우수한 수준을 보인다. MoE 모델은 고성능 AI 서비스를 저비용으로 구현하고자 하는 기업과 연구자들에게 실질적인 대안이 될 수 있다.

카카오는 이번 모델 공개를 통해 경량성과 성능을 모두 갖춘 AI 모델의 새로운 기준을 제시하고, 다양한 연구자와 스타트업이 자유롭게 활용할 수 있도록 아파치 2.0 라이선스를 적용했다. 향후에도 자체 기술 기반의 모델을 지속 고도화해 글로벌 초거대 AI 모델 개발에도 도전할 계획이다.

김병학 카카오 카나나 성과리더는 "이번 오픈소스 공개는 비용 효율성과 성능이라는 두 가지 측면에서 유의미한 기술 성과"라며, "단순한 아키텍처 진보를 넘어 서비스 적용과 기술 자립을 동시에 실현한 결과물"이라고 밝혔다.

한편 카카오는 지난해 자체 AI 모델 '카나나' 라인업을 처음 선보인 이후, 오픈소스를 통해 성능과 개발기를 꾸준히 공개해왔다. 올해 5월에는 2월 말 첫 오픈소스 모델 대비 성능을 개선한 Kanana 1.5 모델 4종을 추가 공개하며 국산 LLM의 실용화 기반을 넓혔다.

dconnect@newspim.com